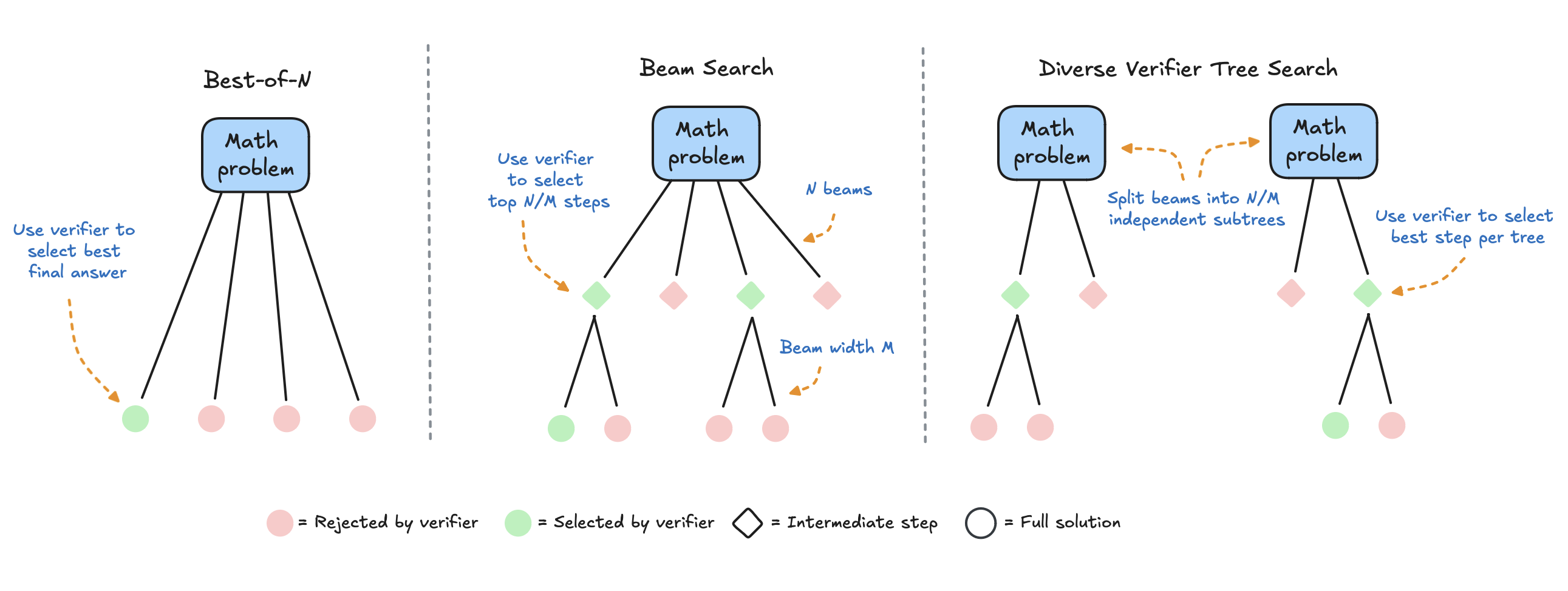

목차1. 개요* 이 글은 HuggingFace의 연구결과를 적용한 방법입니다. 최근 몇 년간 대규모 언어 모델(LLM)의 성능은 모델 크기와 데이터셋 크기를 늘리는 Train-Time Compute Scaling 방식에 의존해 발전해왔습니다. 하지만 이 접근법은 비용이 크고, 자원이 제한된 환경에서 실행하기 어렵습니다. 이를 해결하기 위해 등장한 개념이 Test-Time Compute Scaling입니다. Test-Time Compute Scaling은 모델이 추론 단계에서 더 "오래 생각(think longer)"하도록 설계된 방법론입니다. 대표적인 예로 OpenAI의 o1 모델이 있지만, closed-source 특성상 구체적인 구현 방법은 공개되지 않았습니다. 이 글에서는 Test-Time Comp..